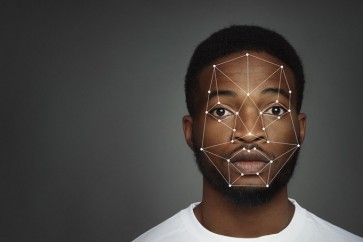

أكد بحث جديد من مختبر وسائل الإعلام في معهد ماساتشوستس للتقنية ما قاله خبراء آخرون أو على الأقل شكوا فيه من قبل، وهو أن تقنية التعرف على الوجه تخضع إلى التحيز استنادا إلى مجموعات البيانات المقدمة والظروف التي تم فيها إنشاء خوارزميات هذه التقنية.

فقد قامت مؤخرا الباحثة في مختبر وسائل الإعلام في معهد ماساتشوستس للتقنية جوي بولامويني ببناء مجموعة بيانات من 1270 وجها، مستخدمة وجوه سياسيين تم اختيارهم بناء على تصنيف بلادهم للتكافؤ بين الجنسين (وبعبارة أخرى، وجود عدد كبير من النساء في المناصب العامة). ثم اختبرت دقة ثلاثة أنظمة للتعرف على الوجه من تطوير شركتي مايكروسوفت و”آي بي أم” الأميركيتين، وشركة “ميغفي” الصينية. وأظهرت النتائج عدم دقة في التعرف على الجنس استناد إلى لون بشرة الشخص.

وفشلت التقنية في التعرف على الجنس بنسبة أقل من 1% عند الذكور الأفتح بشرة، وبنسبة 7% عند الإناث الأفتح بشرة، وارتفعت النسبة إلى 12% عند الذكور ذوي البشرة الداكنة، وإلى 35% عند الإناث ذوات البشرة الداكنة.

وقالت بولامويني في ورقة عن النتائج التي شارك في تأليفها الباحث في مايكروسوفت تيمنت غيبرو، “بشكل عام، تم تحديد الذكور بدقة أكبر من الإناث، في تكرار لنتائج سابقة، وتم التعرف على عناصر البحث الأفتح بشرة بدقة أكبر من الأفراد الداكني البشرة”

وليست هذه المرة الأولى التي أثبتت فيها تقنية التعرف على الوجه عدم دقتها، ولكن تزايدت كثيرا الأدلة التي تشير إلى الحاجة إلى مجموعات متنوعة من البيانات، إلى جانب الحاجة إلى تنوع بين الأشخاص الذين ينشئون وينشرون هذه التقنيات لكي تتعرف الخوارزميات بدقة أكبر على الأفراد بغض النظر عن العرق أو المُعرِّفات الأخرى.

يذكر أنه في العام 2015 تعرضت شركة غوغل للانتقاد لأن تطبيق الصور الخاص بها تعرف على أشخاص سود البشرة على أنهم “غوريلات”، ووعدت الشركة بإصلاح الأمر، رغم أنها قد تكون في حقيقة الأمر قد أزالت كلمة “غوريلات” من فهرس نتائج البحث في التطبيق.

المصدر: مواقع